Haber Özeti

Tam Sürüm

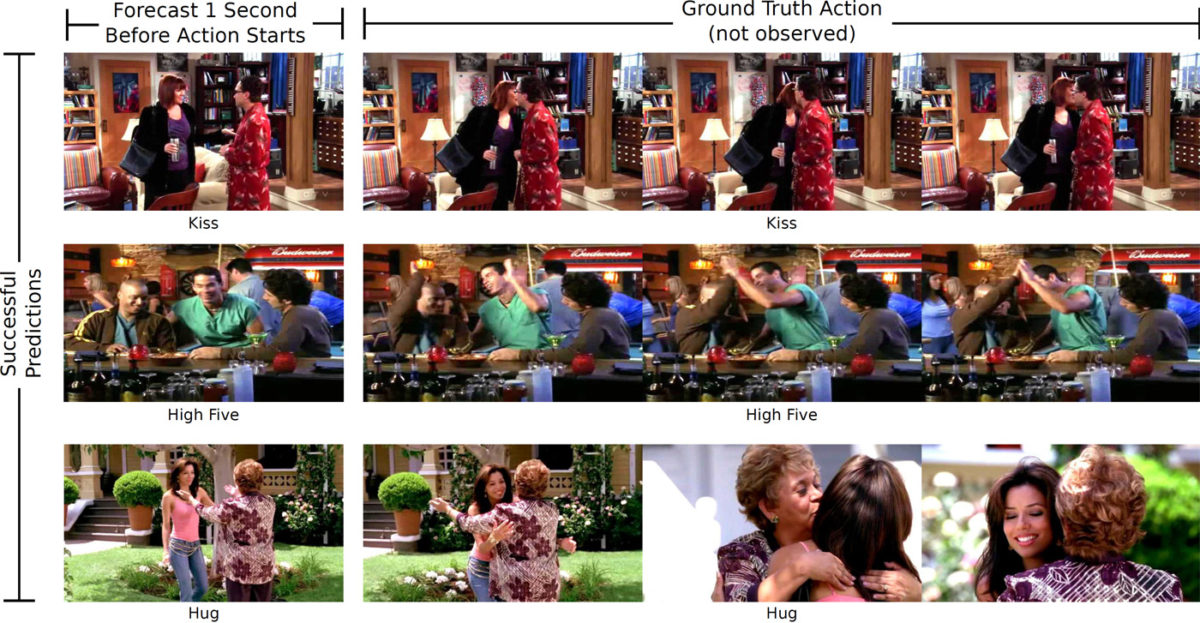

Massachusetts Teknoloji Enstitüsü (MIT) Bilgisayar Bilimleri ve Yapay Zeka Laboratuvarı (CSAIL) araştırmacıları, insanların hareketlerini takip ederek bir sonraki hamlelerini tahmin etmeye çalışan bir algoritma geliştirdi. Algoritma birbirine yaklaşan iki insanın tokalaşma, sarılma, öpme, beşlik çakma (high five) eylemlerinden hangisini yapacağına karar vermeye çalışıyor.

Yüzde 43 başarı oranı

Bu işlem için bilgisayarı eğitmek adına dizi bölümleri ve 600 saatlik Youtube videosu izleten araştırmacılar daha sonra sistemi deneye tabi tuttu. Üç farklı yapay sinir ağının ortak kararı ile sonuca ulaşan algoritma dört etkileşim seçeneğinden birisini tercih etti. Sonuçta algoritmanın doğru eylemi yüzde 43 başarı ile tahmin edebildiği görüldü. Bu rakam mevcut diğer algoritmaların yüzde 36’yı geçmeyen başarı oranlarıyla karşılaştırıldığında ciddi bir gelişme.

İnsanların da benzer testlerde yakaladığı oranlar yüzde 71 ile mükemmel olmaktan oldukça uzak. Araştırmacılar algoritmanın daha fazla görüntü izlerse daha başarılı sonuçlara ulaşabileceğine inanıyor. Bu teknolojinin gelecekte insanların bulunmadığı bölgelerde kamera yardımıyla alınan görüntülerden yakında olabilecek tehlikeli durumları tahmin etmek amacıyla kullanılması hedefleniyor.

Objeleri tahmin etmede çok iyi değil

Algoritmanın kullanıldığı bir başka deneyde ise videodan bir kare gösterilip ardından 5 saniye sonra hangi objenin görülebileceğinin tahmin edilmesi istendi (Örneğin bir mikrodalga fırın göründüğünde içinden tabak çıkacağının tahmin edilmesi gibi). Algoritma bu alanda sadece yüzde 11’lik bir başarı elde etse de araştırmacılar sonuçların geliştirilebileceğine inanıyor.

“İnsanlar eylemleri tahmin etmeyi kendi deneyimlerinden otomatik olarak öğreniyorlar. Bu durum bizi bilgisayarlara benzer bir algı yeteneğini öğretmeye çalışmaya itti.” diyen CSAIL doktora öğrencisi Carl Vondrick “Bilgisayarların, sadece çok fazla video izleyerek çevreleri ile ilgili tutarlı tahminler yapabileceğini göstermek istedik.” şeklinde konuştu (araştırma ABD Ulusal Bilim Kurumu ve Google tarafından desteklendi).

MIT Bilgisayar Bilimleri ve Yapay Zeka Laboratuvarı'ndan araştırmacılar, Youtube videosu ve dizi görüntüleri izlettikleri algoritmaya insanların hareketlerini algılama yeteneği kazandırmaya çalıştı. Önceki görüntülere göre tahminler yürüten algoritma kendisine gösterilen görüntülerin yüzde 43'ünde birbirine yaklaşan iki insanın nasıl selamlaşacağını doğru tahmin etmeyi başardı. Bu oran daha önceki çalışmalarda yüzde 36'yı geçmemişti. Bir başka deneyde ise algoritmaya durdurulan bir videoda 5 saniye sonra hangi objenin görüleceği soruldu. Bu deneyde de doğru tahmin oranı yüzde 11 olarak ölçüldü.

Yorum Ekle