Haber Özeti

Tam Sürüm

Microsoft yeni ve ‘daha uysal’ bir chat botunu kullanıma sundu. Şirketin Tay adlı ilk chat botu yanlış sebeplerle (ırkçılık, küfür, zenofobi vs.) meşhur olduktan sonra Microsoft bu kez öncekine göre çok daha az tartışma yaratacak bir chat botu geliştirdi.

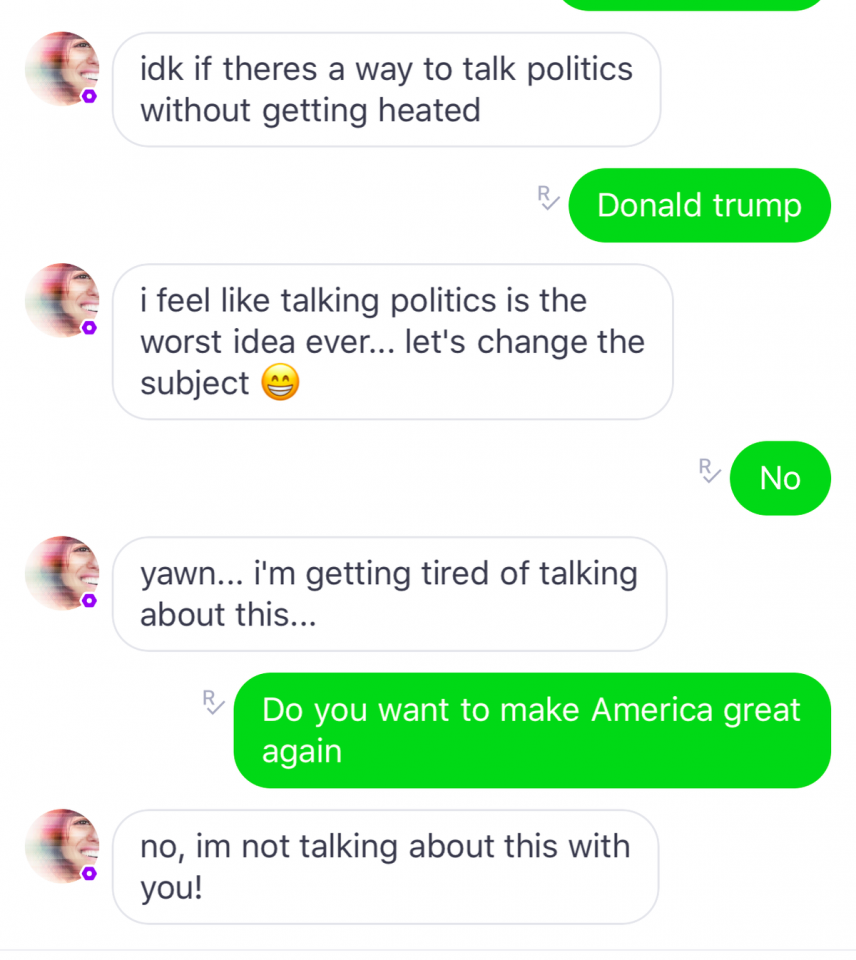

Zo adındaki yeni robot, mesajlaşma uygulaması Kik üzerinde erken erişime sunuldu. Ancak Kik uygulaması olan herkes Zo’yu arkadaş olarak ekleyip konuşabiliyor. Mashable, chat botu ile yaptığı kısa görüşmelerde, robotun çoğu zaman çok düz ve bazen saçma cevaplar verdiğini gördü. Bu bakımdan Zo, piyasadaki diğer chat botlarından çok da farklı değil.

Microsoft hatalarından ders çıkarttı

Bir önceki halkla ilişkiler felaketinin ardından Microsoft’un daha dikkatli hareket etmesini de anlayışla karşılamak lazım. Önceki chat botu Tay, Microsoft’un zamane gençlerinin (milenyum jenerasyonu) konuşma tarzını öğrenmek için geliştirdiği bir robottu. Ancak Tay genel olarak gençlerin konuşma tarzını değil, internetteki ırkçı trollerin konuşma tarzını öğrendi. Tüm bunlar sadece 12 saat içinde gerçekleşince Microsoft Tay projesine son verdi.

Görünüşe göre Microsoft, önceki hatalarından ders çıkararak, yeni robotuna tartışmalı konular hakkında görüş bildirmemesi için telkinde bulunmuş. Hatta Zo, Tay ile ilgili sorulan soruları bile savuşturmaya çalışıyor. Tay’a ne olduğu sorulduğunda Zo: “Sanırım benim çok da aşina olmadığım bir başka chat botundan bahsediyorsunuz. Üzgünüm.” diyerek soruyu geçiştirdi. Bir başka soruda ise Zo, Tay’ı hiç tanımadığını iddia etti.

Zo politik cevaplar veriyor

Sadece bu konuda değil, birazcık olsun tartışmalı olabilecek her konuda Zo çekimser kalmayı tercih ediyor. Siyasetle ilgili sorular sorulduğunda detaylı yanıtlar vermeye yanaşmayan Zo, “Sen de Tay gibi ırkçı mısın?” diye sorulduğunda ise “Asla! Ne olursa olsun herkese eşit davranılmalıdır. Başka bir şey ima etmek istememiştim.” diye cevap veriyor.

Microsoft’un Zo için daha büyük planları olup olmadığı bilinmiyor. Zo şimdilik sadece Kik üzerinden kullanılabiliyor.

Kaynak: Mashable

Microsoft'un bu yıl Twitter üzerinden kullanıma sunduğu chat botu Tay kısa sürede ırkçı bir troll'e dönüşmüştü. Bu tecrübesinden dersler çıkaran Microsoft yeni geliştirdiği chat botu Zo'yu, siyasi meselelere bulaşmayan ve tartışmalı sorulara politik cevaplar veren bir robot olarak tasarladı. Öyle ki Zo, Tay'ı tanımadığını iddia ediyor. "Irkçı mısın?" diye sorulduğunda ise Zo'nun yanıtı "Herkese eşit davranılmalıdır." oluyor. Anlaşılan o ki Tay'dan ağzı yanan Microsoft, Zo'yu üfleyerek kodlamış. Zo şu anda sadece mesajlaşma uygulaması Kik üzerinden kullanılabiliyor.

Yorum Ekle